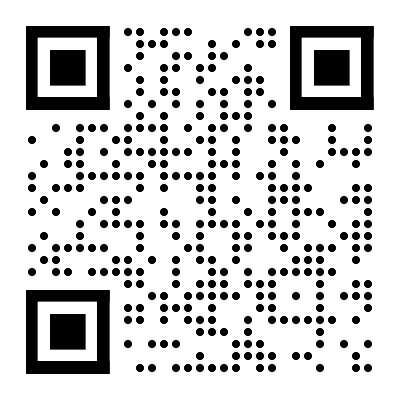

微信扫一扫联系客服

微信扫描二维码

进入报告厅H5

关注报告厅公众号

Dive into hyperparameter tuning of machine learning models and focus on what hyperparameters are and how they work. This book discusses different techniques of hyperparameters tuning, from the basics to advanced methods.

This is a step-by-step guide to hyperparameter optimization, starting with what hyperparameters are and how they affect different aspects of machine learning models. It then goes through some basic (brute force) algorithms of hyperparameter optimization. Further, the author addresses the problem of time and memory constraints, using distributed optimization methods. Next you’ll discuss Bayesian optimization for hyperparameter search, which learns from its previous history.

The book discusses different frameworks, such as Hyperopt and Optuna, which implements sequential model-based global optimization (SMBO) algorithms. During these discussions, you’ll focus on different aspects such as creation of search spaces and distributed optimization of these libraries.

Hyperparameter Optimization in Machine Learning creates an understanding of how these algorithms work and how you can use them in real-life data science problems. The final chapter summaries the role of hyperparameter optimization in automated machine learning and ends with a tutorial to create your own AutoML script.

Hyperparameter optimization is tedious task, so sit back and let these algorithms do your work.

What You Will Learn

Discover how changes in hyperparameters affect the model’s performance.

Apply different hyperparameter tuning algorithms to data science problems

Work with Bayesian optimization methods to create efficient machine learning and deep learning models

Distribute hyperparameter optimization using a cluster of machines

Approach automated machine learning using hyperparameter optimization

Who This Book Is For

Professionals and students working with machine learning.

潜心研究机器学习模型的超参数调优,关注什么是超参数以及它们如何工作。本书讨论了超参数调整的不同技术,从基础知识到高级方法。

这是一本循序渐进的超参数优化指南,首先介绍了什么是超参数以及它们如何影响机器学习模型的不同方面。然后,它介绍了超参数优化的一些基本(蛮力)算法。此外,作者使用分布式优化方法,解决了时间和内存限制的问题。接下来你会讨论超参数搜索的贝叶斯优化,它可以从以前的历史中学习。

本书讨论了不同的框架,如Hyperopt和Optuna,它实现了基于模型的顺序全局优化(SMBO)算法。在这些讨论中,你将专注于不同的方面,如搜索空间的创建和这些库的分布式优化。

机器学习中的超参数优化》让你了解这些算法是如何工作的,以及你如何在现实生活中的数据科学问题中使用它们。最后一章总结了超参数优化在自动化机器学习中的作用,并以创建自己的AutoML脚本的教程结束。

超参数优化是一项繁琐的工作,所以请坐下来,让这些算法为你工作。

你将学到什么

发现超参数的变化如何影响模型的性能。

在数据科学问题上应用不同的超参数调整算法

使用贝叶斯优化方法来创建高效的机器学习和深度学习模型

使用机器集群分布式超参数优化

使用超参数优化接近自动化机器学习

本书适用对象

从事机器学习的专业人士和学生

相关文库

计算机行业:AIGC行业应用畅想-华福证券

2798

类型:行研

上传时间:2023-04

标签:计算机、AIGC)

语言:中文

金额:5积分

零信任SaaS,美国经验与中国特色-20200802-天风证券-42页

2651

类型:行研

上传时间:2020-08

标签:计算机、saas)

语言:中文

金额:免费

计算机行业安全服务:网络安全行业的制高点-20210221-方正证券-64页

2368

类型:行研

上传时间:2021-02

标签:计算机、网络安全)

语言:中文

金额:免费

2021年IEEE高新能计算论文合集

2340

类型:学习教育

上传时间:2021-05

标签:高性能计算、学术、计算机)

语言:中文

金额:30积分

计算机行业专题研究:MES深度报告下篇,7大海外巨头,6家中国领军全梳理-20201015-天风证券-55页

2264

类型:行研

上传时间:2020-10

标签:计算机、MES)

语言:中文

金额:免费

计算机行业:信创产业发展研究-20220510-东吴证券-84页

1719

类型:行研

上传时间:2022-05

标签:计算机、信创)

语言:中文

金额:免费

计算机行业对于低代码工具发展的思考:AI降低软件使用门槛,交付自动化提升工具价值

1597

类型:行研

上传时间:2023-06

标签:计算机、AI、低代码)

语言:中文

金额:5积分

计算机行业:工业软件,研究框架-20200618-华泰证券-132页

1468

类型:行研

上传时间:2020-07

标签:计算机、工业软件、券商报告)

语言:中文

金额:免费

2020年高考志愿填报全解析—计算机行业报考热门专业、院校及前景(免费

1289

类型:专题

上传时间:2020-07

标签:高考志愿填报、计算机)

语言:中文

金额:5积分

2023年中国服务器操作系统行业市场研究报告

1263

类型:行研

上传时间:2023-03

标签:服务器、操作系统、计算机)

语言:中文

金额:5积分

积分充值

30积分

6.00元

90积分

18.00元

150+8积分

30.00元

340+20积分

68.00元

640+50积分

128.00元

990+70积分

198.00元

1640+140积分

328.00元

微信支付

余额支付

积分充值

应付金额:

0 元

请登录,再发表你的看法

登录/注册